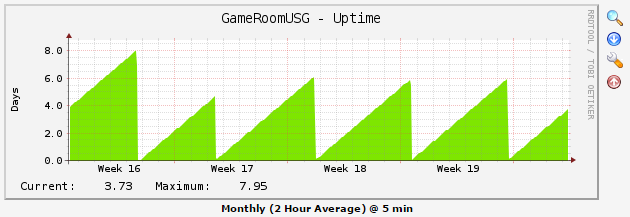

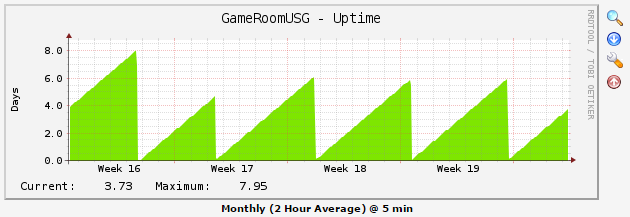

С тех пор как я обновился до версии 4.3.41.4975503, мой USG становится нестабильным каждые 4-6 дней. Вот как выглядело время без перезагрузок за последний месяц (из-за необходимости перезапускать устройство, чтобы всё стабилизировать):  Когда начинаются пропуски heartbeat, они случаются с интервалом в 5-15 минут. При этом нагрузка на ресурсы устройства тоже скачет без видимой причины. Если посмотреть на утреннюю перезагрузку, можно заметить чрезмерное использование CPU без реальных причин:

Когда начинаются пропуски heartbeat, они случаются с интервалом в 5-15 минут. При этом нагрузка на ресурсы устройства тоже скачет без видимой причины. Если посмотреть на утреннюю перезагрузку, можно заметить чрезмерное использование CPU без реальных причин:  Также это отражается и в системной нагрузке:

Также это отражается и в системной нагрузке:  Кто-нибудь ещё сталкивался с такой проблемой? Я полностью сбрасывал настройки, не использую json-файлы, вся конфигурация идёт напрямую с контроллера и не менялась уже год, но проблема появилась примерно в последний месяц-два (то есть после выхода этой версии прошивки USG).

Кто-нибудь ещё сталкивался с такой проблемой? Я полностью сбрасывал настройки, не использую json-файлы, вся конфигурация идёт напрямую с контроллера и не менялась уже год, но проблема появилась примерно в последний месяц-два (то есть после выхода этой версии прошивки USG).

Когда начинаются пропуски heartbeat, они случаются с интервалом в 5-15 минут. При этом нагрузка на ресурсы устройства тоже скачет без видимой причины. Если посмотреть на утреннюю перезагрузку, можно заметить чрезмерное использование CPU без реальных причин:

Когда начинаются пропуски heartbeat, они случаются с интервалом в 5-15 минут. При этом нагрузка на ресурсы устройства тоже скачет без видимой причины. Если посмотреть на утреннюю перезагрузку, можно заметить чрезмерное использование CPU без реальных причин:  Также это отражается и в системной нагрузке:

Также это отражается и в системной нагрузке:  Кто-нибудь ещё сталкивался с такой проблемой? Я полностью сбрасывал настройки, не использую json-файлы, вся конфигурация идёт напрямую с контроллера и не менялась уже год, но проблема появилась примерно в последний месяц-два (то есть после выхода этой версии прошивки USG).

Кто-нибудь ещё сталкивался с такой проблемой? Я полностью сбрасывал настройки, не использую json-файлы, вся конфигурация идёт напрямую с контроллера и не менялась уже год, но проблема появилась примерно в последний месяц-два (то есть после выхода этой версии прошивки USG).

На консоли шлюза появляются те же ошибки:

На консоли шлюза появляются те же ошибки: